via twitter

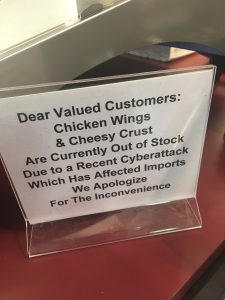

Derzeit ist überall Digitalisierung. In fast allen bis vor kurzem nicht digital überbauten gesellschaftlichen Bereichen hält irgendwie die Digitalisierung Einzug. Damit wird auch IT-Sicherheit in Bereichen zum Thema, die bisher noch nicht digital angreifbar waren. Cyberangriffe allerorten. Neulich waren die Chicken Wings aus: Cyberangriff. Kann man nix machen. Cyber mag für den einen oder die andere immer noch aufregend und nach Neuland klingen. Mit dem Hebel „Cyberwar“ werden Milliarden öffentlicher Gelder in Richtung sich werbewirksam präsentierender Startups und IT-Konzerne und neuer Bürokratien umverteilt. Produziert wird dort dann Pseudo-Sicherheit à la IT-Sicherheitskennzeichen (etwas nach unten scrollen, dort machen sie immerhin transparent, was das „Sicherheitskennzeichen“ nicht kann…).

Aber IT-Sicherheit ist kein neues Thema. Streng genommen sind die mathematischen Grundlagen von IT-Sicherheit nicht einmal ein digitalistisches Thema. Zum Beispiel das Kerckhoffs’sche Prinzip: Im Jahr 1883, lange vor der Existenz jeder automatischen Rechenmaschine, formulierte der niederländische Sprachforscher Auguste Kerckhoff dieses bis heute gültige grundlegende Gesetz der Wissenschaft von der Verschlüsselung („Kryptographie“). Es besagt, dass die Sicherheit eines Verschlüsselungsverfahrens nicht auf der Geheimhaltung der Art und Weise der Verschlüsselung („Verschlüsselungsalgorithmus“) beruht, sondern auf der Geheimhaltung lediglich des Schlüssels (bzw. der Kombination aus Schlüssel und Passwort).

Inhaltsgliederung

- 1 Sicherheitslücke. Wat nu?

- 2 IT-Sicherheit und Quellfreiheit

- 3 Sicherheitslücke Mensch: Manuelle Einstellungen und Phishing

- 4 Freiheit statt Angst

- 5 IT-Sicherheit als Verfügungssicherheit über die Zeit

- 6 Quelloffen und professionell

- 7 „Cyber“ als linkes bildungspolitisches Programm

- 8 Vergesellschaftungsmodus follows Produktionsweise

- 9 Ähnliche Themen

Sicherheitslücke. Wat nu?

Das selbe gilt für den Umgang mit Sicherheitslücken in Hardware und Software. Die Veröffentlichung einer Lücke und die Berichterstattung darüber macht angemessene Reaktionen erst möglich: den Austausch betroffener Hardware, das Überarbeiten („patchen“) betroffener Software oder im schlimmsten Fall die vorübergehende Abschaltung eines betroffenen Systems, um die feindliche Ausnutzung eines bis auf weiteres nicht behebaren Sicherheitsproblems auszuschließen.

Für die politische Debatte folgt hieraus: Wer Computersicherheit möchte, muss die Nutzung neu entdeckter, bisher unbekannter Sicherheitslücken („Zero Days“) und den Handel damit – auch durch Polizei, Militär und Geheimdienste („Hackback“) – nicht nur untersagen, sondern auch verhindern. Hier können großzügig angelegte Belohnungsprogramme für die Veröffentlichung von Sicherheitslücken („Bug Bounty“) ansetzen (im Prinzip richtig, aber nicht großzügig: Bug Bounty-Programm der EU). Nebenbei: Ein weitverbreitetes Protokoll („Responsible Disclosure“) sichert den Herstellern lückenhafter Software eine Frist vor der allgemeinene Veröffentlichung einer Lücke zu, sodass zeitgleich mit dem öffentlichen Bericht über die Lücke auch der Patch zugänglich sein kann.

Wird eine kritische Sicherheitslücke bekanntgemacht, dann macht es den entscheidenenden Unterschied, ob es sich beim betroffenen System selbst um eines handelt, dessen Funktionsweise vom Hersteller geheimgehalten wird („Closed Source“, „proprietäre“ Software) oder ob sie in menschenlesbarer Form als Programmtext im Falle von Software oder als Schalt- und Designplan offenliegt („Open Source“, „quellfreie“ Software).

IT-Sicherheit und Quellfreiheit

Im Falle von Closed Source stehen die Betroffenen in der Regel im Kundenverhältnis zum Hersteller und sind von diesem abhängig, was die Versorgung mit Patches angeht. Im besten Fall kommt der Patch mit der Veröffentlichung. Im schlechtesten Fall gibt es keinen Patch, weil es für den Hersteller nicht profitabel ist zu patchen (ein besonders dramatischer Fall, während ich das hier schreibe: Eine Lücke im GPS-Tracker von Autos macht diese durch Angreifer von Außen vollbremsbar, seit September 2021 liefert der Hersteller keinen Patch). Es steckt konkurrenzgetriebene, profitmaximierende Methode dahinter: In der Geräteklasse der Router, das sind die Verbindungsgeräte zwischen privatem Heimnetz und den diversen Netzen des Internet, ist es eher üblich ein neues Gerät zu kaufen, als vom Hersteller Patches geliefert zu bekommen.

Oft muss also eine Abwägung stattfinden zwischen Sicherheitsdesaster (Gerät mit Sicherheitslücke weiterbetreiben) und ökologischem Desaster (funktionsfähiges Gerät verschrotten), denn Interneteinwahl und -routing sind ziemlich einfache Aufgaben, wenn es um die Ansprüche an die Hardware geht. Ein 15 Jahre altes Gerät kann, wenn die veraltete Herstellersoftware durch tagesaktuelle Freie Software ersetzt wurde, die Ansprüche auch im Jahre 2022 noch sicher, stabil und flüssig bedienen. Nicht anders verhält es sich mit Computern und Laptops (wenn wir nicht gerade als Klimaforscher aufwendige Wettersimulationen laufen lassen) oder mit Smartphones, wenn wir sie im Grunde nur zum Kommunizieren und vielleicht mal als eBook-Lesegerät oder Navi benutzen wollen.

Hat man das Glück oder war so klug, bei der Auswahl seiner IT-Infrastruktur auf Open Source Software (Betriebssystem und Programme, Apps) und gar Open Source Hardware gesetzt zu haben, dann sieht der schlechteste Fall so aus, dass man selbst oder eine extra für diesen Zweck angeheuerte Programmiererin den Patch schreiben kann. Meist jedoch und im Falle einigermaßen populärer Projekte fast immer tritt der beinahe beste Fall ein: Die Programmier_innen-Gemeinde, die an der Software sowieso kontinuierlich arbeitet, liefert einen Patch innerhalb von Stunden. Jetzt ist es nur noch wichtig, den Patch auch wirklich einzuspielen oder das System so eingestellt zu haben, dass es Sicherheitsaktualisierungen automatisch und sofort installiert.

Sicherheitslücke Mensch: Manuelle Einstellungen und Phishing

Das bringt uns zum Thema Einstellungen und Voreinstellungen und überhaupt: Nutzerverhalten. Das sicherste System wird unsicher und angreifbar, wenn ich eine Einstellung so ändere, dass ich – absichtlich oder unabsichtlich – eine Lücke öffne. Hier kommen die Arbeitsbedingungen des IT-Personals ins Spiel – oder die Schwerpunktsetzungen in IT-bezogener Ausbildung: Hat das IT-Personal genug Zeit, beim Aufbau neuer Dienste, bei der Realisierung neuer Features vernünftig zu planen und zu testen? Oder ist der Arbeitsdruck so groß, dass es immer nur gerade so reicht, vorne auszubessern, was gerade mit dem Hintern eingerissen wurde? Ist der Erfolgsdruck im Startup so hoch, dass die pünktliche Fertigstellung der glänzenden Oberfläche auf Kosten von Sicherheit und Stabilität geht?

Aber nicht nur manuelle Einstellungen können Sicherheitslöcher öffnen. Benutzeraktionen, die Lücken öffnen, lassen sich auch von außen gezielt provozieren. Ein solches Vorgehen heißt Phishing. Streng genommen verlassen wir hier den Bereich der technischen Lücke und gelangen in den menschlichen Bereich. Ein Phishingangriff zielt darauf, einen Menschen zu einem Fehler zu verleiten, der eine Lücke öffnet, die dann technisch ausgenutzt werden kann. Dementsprechend lässt sich Phishing mit analogen Methoden wie Telefonbetrug unter dem Begriff Social Engineering fassen.

Sozial ist dementsprechend auch die Ebene der Gegenwehr: Lebens- und Arbeitsverhältnisse, die uns nicht nur Zeit zum Atmen, sondern auch zum Nachdenken lassen, wenn uns etwas komisch vorkommt, können den allergrößten Teil von Phishingangriffen vereiteln (und gerade die sozial eher schlecht gemachten, massenhaft automatisch generierten). Letztlich wären in diesem Zusammenhang auch Digitalisierungs- oder Netzanbindungsmoratorien in Bereichen wirklich kritischer Infrastrukturen zu diskutieren. Die Bundeswehr macht mit einem Teil ihres Etats für „Digitalisierung“ genau das: eigene Kabel zwischen ihren Standorten bundesweit verlegen. Auch das Nachdenken über ein Recht auf Digitale Abstinenz bezieht hierher einen Teil seiner Berechtigung: Niemand sollte gezwungen sein, digital oder auch nur internetbasiert zu kommunizieren. Wer kein Smartphone/Internet will, dem sollten zumindest Behörden, Daseinsvorsorge- und Kultureinrichtungen weiterhin analog Zugang bieten müssen.

Zurück zu den (Vor-)Einstellungen: Anders als beim „Faktor Mensch“ bedeutet da Open und Closed Source einen entscheidenden Unterschied: Bei der Software mit dem geheimgehaltenen Code sehe ich nur die Einstellungen, die mich der Hersteller sehen lassen will. Will ich den Werbeversprechungen des Anbieters nicht blind vertrauen, dann bleibt mir nur die Möglichkeit zu messen, was das Programm oder Betriebssytem sonst so macht, wie es auf diverse Angriffs- und Überwachungsvarianten reagiert. Offener Quellcode ist in seiner gesamten Funktionsweise transparent, auch was die Voreinstellungen angeht.

Freiheit statt Angst

Letztlich steht der lust- und gebrauchswertorientierte Kosmos der quelloffenen Software alternativ zur angstbasierten, profitorientierten Warenwelt der IT- und Plattformkonzerne. Die Produktionsweise von Software wirkt sich auch auf Designprinzipien, Funktionsweisen und Voreinstellungen zum Auslieferungszeitpunkt aus. In dieser Perspektive steht das closed in Closed Source für die Einsperrung der Kunden in die Warensammlung eines Herstellers und seiner strategischen Verbündeten. Open Source bedeutet offene Standards und Schnittstellen und damit Offenheit aller Möglichkeiten: Theoretisch lässt sich alles mit allem verbinden. Sobald es jemanden gibt, der oder die eine Funktionalität unbedingt will, wird sie programmiert. Selbst die Closed Source-Welt steht offen: Aus dem Open Source-Ansatz heraus lassen sich geheime oder undokumentierte Schnittstellen experimentell erforschen und nachbauen („reverse engineering“) und so an die Programme und Betriebssysteme, aber auch an die Hardware der kommerziellen Hersteller andocken.

Es gibt kaum etwas, was es nicht gibt in der Open Source-Welt. Ein Problem kann es darstellen, zu finden, was man sucht. Vielleicht weil das Programmierprojekt größtenteils in Italienisch dokumentiert ist. Oder weil man beim Suchen von einer ganz anderen Ecke aus kommt und einfach nicht die richtigen Suchbegriffe findet. Und ganz generell: Weil Open Source-Projekte keine Werbeetats haben. Sie zahlen nicht fürs Suchmaschinen-Ranking. Manchmal haben sie nicht einmal eine Webseite: Alle Außendarstellung läuft vielleicht nur über die Startseite der Versionsverwaltungsplattform („Git“), wo auch die Diskussion der Funktionalität und die Koordination der Programmierarbeit und damit die Entwicklung selbst stattfindet.

IT-Sicherheit als Verfügungssicherheit über die Zeit

Datensicherheit bedeutet auch: Kann ich sicher sein, dass ich meine Daten in 10 oder 20 Jahren noch verarbeiten kann? Oder nach einem Plattformwechsel? Ist ein solcher überhaupt möglich, oder bin ich mit meinen Daten auf Gedeih und Verderb dem Plattformbetreiber ausgeliefert? Offene Standards und Schnittstellen machen das Ein- und Ausspielen von Datenbeständen grundsätzlich möglich. In der Open Source-Welt sind Konvertierungsprogramme und Import-Export-Module zwischen konkurrierenden Ansätzen zur Lösung eines Anwendungsfalles weit verbreitet – einfach deshalb weil sie möglich sind und es immer jemanden gibt, der oder die programmieren kann, eine Plattform wechseln will und das dafür zusammengebastelte Tool auch wieder öffentlich zur Verfügung stellt (oder gleich kollektiv herstellt, falls es andere gibt, die das auch interessiert und die bei der Arbeit im Git einsteigen).

Quelloffen und professionell

Aber nicht alle Open Source-Projekte sind Nischenprojekte fusselbärtiger Nerds. Ganze Abteilungen in IT-Konzernen sind freigestellt für die Arbeit an für den Konzern strategisch bedeutsamen Open Source-Projekten. Hier geht es oft auch um die (Mit-)Bestimmung in der Community, etwa was besondere Richtungsentscheidungen angeht, die die Verwendung der Software durch den Konzern beeinflussen könnte. Oder es geht um die Anbindung und Ausbeutung unbezahlter Arbeit: Wenn der Konzern bei der Software seiner Geräte oder der Codierung seiner Multimedia-Inhalte ganz oder teilweise auf quellcodefreie Software setzt. Schließlich gibt es wichtige, oft sicherheits- und/oder netzwerkarchitekturbezogene Projekte, die sich neben oder um kommerzielle Ansätze organisieren. Sie heben den Infrastrukturcharakter ihrer quelloffenen Software hervor und holen damit finanzstarke Nutzer_innen (Konzerne, Behörden) zur Finanzierung ins Boot (Stiftungsmodelle). An dieser Stelle sei ein weiterführender Literaturhinweis erlaubt: Die Rolle von Freier Software als Durchlauferhitzer für Innovation, Rationalisierung und Profitsteigerung in der kapitalistischen Digitalwirtschaft und die Möglichkeiten, die Freie Software im Hinblick auf das Öffentliche bietet, hat Marco Berlinguer in seiner Studie für die RLS im Jahr 2020 herausgearbeitet: „Commons, Märkte und öffentliche Politik“.

Ich fasse zusammen: IT-Sicherheit ist ein seit langem etabliertes wissenschaftlich-technisches Feld. Es gibt starke Regeln und belastbare Prinzipien. Offenheit ist besser als Heimlichtuerei. Open Source und Business schließen einander nicht aus. Sicherheitskompatible IT-Geschäftsmodelle basieren eher auf Service, Support und Administration. Viele Open Source-Projekt arbeiten professionell, aber nicht profitorientiert.

„Cyber“ als linkes bildungspolitisches Programm

In der Praxis und für die politische Bildungsarbeit bedeutet das, dass es beim Thema Cyber, oder besser: IT-Sicherheit, weniger um das fragende Voranschreiten geht als in anderen Politikbereichen. Der Infrastruktursozialismus ist hier – durch die Hintertür der Freie Software-Lizenzen – sozusagen schon da: in Form der weitestgehend quellcodeoffenen Internetinfrastruktur und eines alle Anwendungsbereiche abdeckenden Angebots an quellcodeoffenen Betriebssystemen und Programmen.

Vielmehr geht es um eine Selbstvergewisserung und die darauf basierende Selbstermächtigung zur Aneignung dieser digitalen Produktionsmittel in quellöffentlicher Form. Das wissen wir heute schon, und das können wir heute schon tun. Da gibts wenig zu fragen außer: Wo treffen wir uns, um loszulegen. Wo es lang geht, ist klar:

- Freie und quelloffene Software (und wo möglich: Hardware) ist Grundvoraussetzung für alles, was vernünftig ist.

- Es sei ein sicherheits- und aktualitätsbetontes Betriebssystem gewählt.

- Man betreibe es soweit wie möglich mit Standardeinstellungen und bewährten Programmen/Erweiterungen.

- Sicherheits- und Stabilitätsbezogene Updates sind obligatorisch.

- IT-Probleme begreife man als Lerngelegenheit und als Gelegenheiten, sich gegenseitig zu helfen und weiterzuentwickeln.

Vergesellschaftungsmodus follows Produktionsweise

Übrigens: Was auf den ersten Blick wie ein handwerkliches Programm aussieht, ist weit mehr, weil die Praxen von einer anderen Handlungslogik strukturiert sind. Denn sobald ich mit quelloffener Software arbeite, fange ich an zu kooperieren – öffentlich und zugunsten Dritter. Kooperationsbasierte Produktionsweise (statt konkurrenzbasierter) im Hier und Jetzt ist Keimform einer neuen Vergesellschaftungsweise. Das zeigt sich mir schon als einfacher Nutzerin in dem Moment, in dem ich mit einem Problem umgehe: Ich gebe mir Mühe, mein Problem in einfachen Worten ausführlich zu beschreiben, um Hilfe in einem Forum zu finden. Oft stolpere ich schon auf der Suche nach dem passenden Ort für meinen Hilferuf über verschiedene, quantitativ und qualitativ gewertete Lösungsvorschläge (vgl. z.B. stackoverflow oder askubuntu). Denn 99% meiner Probleme sind nicht so originell, dass nicht schon wer anders das gleiche gehabt hätte. Der gegenseitige Support bei Problemen mit quelloffener Software läuft in öffentlichen Foren zusammen und bleibt öffentlich. Bei kommerziellem Support wird eine einmal gefundene Lösung in der Regel nicht öffentlich. Sonst würde ja niemand für Support zahlen.

Wenn uns also ein Verein wie Microsoft erzählen will, wie IT-Sicherheit geht, am ganz großen internationalen Beispiel, nämlich wie die „Ukraine im Cyberwar verteidigt“ wird, oder wenn der Inlandsgeheimdienst mit der Neuigkeit um die Ecke kommt, dass die größte Cybergefahr in Zukunft nicht rot sondern gelb sei, dann können wir sagen: Lasst mal gut sein. Wir lassen uns nicht cybern, so schon gar nicht und auch nicht von Euch. Wir verteidigen uns selbst – und hacken dabei die Welt. Mit quelloffener Software, vernünftigen, nicht von Konzern- oder Staatsinteressen bestimmten Voreinstellungen, regelmäßigen Sicherheitspatches der Communities und selbstauferlegter Datensparsamkeit und Netzwerkenthaltsamkeit. Omas Kirschpolster back ich (seit sie von einem Besoffenen totgefahren worden ist) auch am besten selbst.